We are Shaping the Future!私たちが手繰り寄せる未来ストーリー

~視覚障がい者の移動とコミュニケーションを支援~

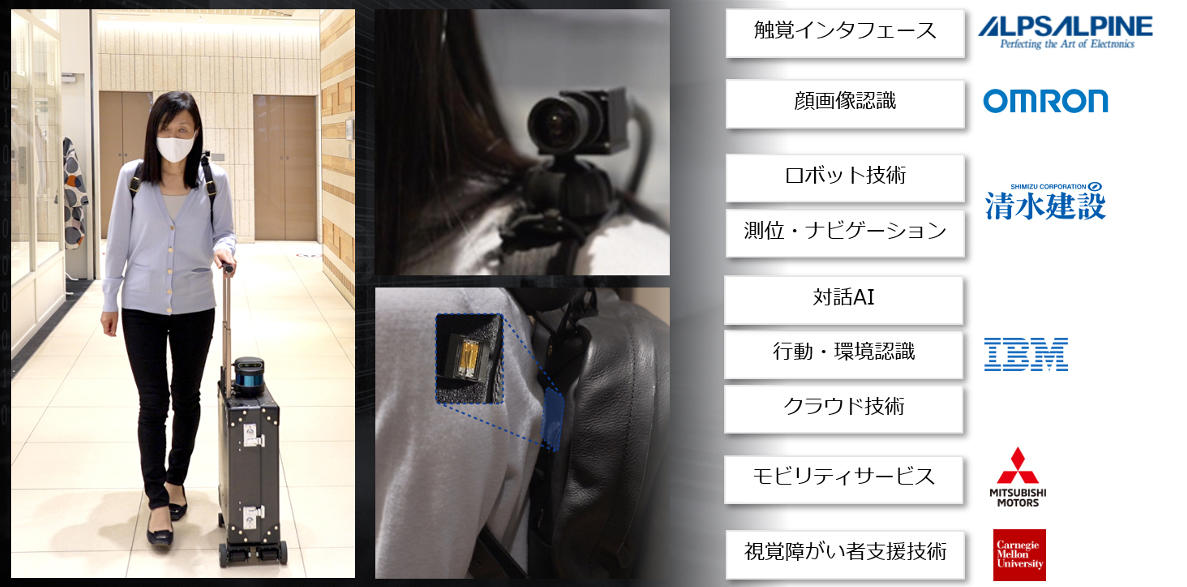

WHOによれば、全世界で視覚に何らかの障がいを持つ人は、約22億人(*1)にものぼるとされています。視覚障がい者が不自由を感じることなく生活できる社会の実現に向けて、オムロンをはじめとした異なる専門分野を持つアルプスアルパイン、清水建設、日本アイ・ビー・エム、三菱自動車の5社は、それぞれが持つ最新のAI・ロボット技術を融合させた「AIスーツケース」プロジェクトを共同で進めています。この記事では、視覚障がいを持つ方々のアクセシビリティ(*2)向上に向けて、各社が手を取り合い、技術を組み合わせながら、社会実装へ向けてチャレンジする実例をご紹介します。

*1 World report on visionより:https://www.who.int/publications/i/item/world-report-on-vision

*2 アクセシビリティ:情報やサービスへのアクセスのしやすさのこと

視覚障がいを持つ人の数は、事故、高齢化による視力の低下や緑内障などの目の疾患発症により年々増加しています。日本国内に限っても、推定164万人の視覚障がい者がおり、その内の18.8万人は全盲の視覚障がい者です。(*3)

こうした視覚障がい者は、日常生活において主に2つのシーンで不自由さを感じています。1つめは、視力が弱い、または失われた結果として、地図を確認して目的地に行けない、人や障害物を避けて通路を歩けないなど「自由に移動する」ことができなくなる点。2つめは、話す相手の表情を読み取れないなどの問題から「自然なコミュニケーション」をとることが難しいという点。どちらも、買い物に行く、会社や学校に行く、旅行に出かけるなど日々の生活を送る中で欠かせない要素です。

このような課題に対して技術の力で解決しようと試みたのが、14歳で失明し、自らも視覚障がいを持つIBMフェロー(最高技術職)の浅川智恵子氏です。浅川氏は、世界初のウェブページ音声読み上げソフトウェアを開発するなど、障がい者の情報へのアクセシビリティ改善に向けての取り組みを行ってきた研究者です。「研究したものは必ず実装すること」をポリシーに活動を続けてきた浅川氏が次のテーマとして掲げたのが、AIを活用した自立移動支援のための統合ソリューション「AIスーツケース」です。

「視覚障がいがあると、1人で安心して街を出歩いて楽しむこともできない。この課題を解決したいが、技術を社会実装するには、多くの壁がある。その壁を乗り越えるために、企業が業種を超え、それぞれがもつ最新のAI・ロボット技術を融合させることが必要となる。」という浅川氏の思いに共感した5社が「一般社団法人次世代移動支援技術開発コンソーシアム」を創設。視覚障がい者の移動とコミュニケーションをサポートする、「AIスーツケース」開発へのチャレンジが始まったのでした。

*3 日本眼科医会研究班報告2006 ~ 2008「日本における視覚障害の社会的コスト」より

コンソーシアムが取り組むAIスーツケースとは、視覚障がい者が自立して街を移動することを助けるもので、ウェアラブルデバイスとスーツケース型ナビゲーション・ロボットのセットからなる統合ソリューションです。デジタルの視覚から得られる情報を、最新のAIとロボット技術の組み合わせによって補い、周囲の状況や障害物の有無はもちろん、すれ違う人の顔や表情を認識してユーザーに伝えることで、移動とコミュニケーションのサポートを行います。スーツケース型にしたことで視覚障がい者が日常生活において無理なく携行でき、常時、ユーザーの傍らで状況に応じた支援ができるのです。

この取り組みにオムロンが賛同したのは、事業を通じて社会的課題の解決に取り組み、技術で新たなイノベーションを生み出すという創業時からのDNAを体現するプロジェクトだったからにほかなりません。オムロンからは、技術・知財本部 研究開発センタ 画像センシング研究室の山本和夫(やまもとかずお)をリーダーとするチームが、これまでに画像認識の分野で培った知見を生かして開発にあたりました。

オムロンは、顔画像認識技術を用いて人との円滑なコミュニケーションを支援する機能の開発を担当しています。具体的には、知っている人を見つけて、話しかけてもよいかどうかを判定するための顔をセンシングする技術の開発です。

まず、ユーザーの肩に乗っているカメラで、およそ5m手前から近づいてくる人を見つけ出します。このカメラの画像を、専用に開発したAIで高解像度化し、周囲の人の顔をリアルタイムで認識します。そして、人が近づいてくるとAIを用いた顔認証で「その人は知っている人か?」を判別し、さらに一定以上の距離に近づくと、今度は表情推定機能を使って、その人の表情や顔の向きなどから、「その人は笑っているか?」「今、話しかけてもよい状態か?」を判断します。最終的にはそれを音声や振動でユーザーに通知する仕組み(*4)の確立を目指しています。視覚障がい者に、相手の情報がより多く伝わることで、いわば「空気を読む」ような自然なコミュニケーションを取ることができるようになります。

とはいえ、現実にはユーザーは屋内・屋外含めてさまざまな場所へと移動します。場所によっては光や明るさの影響を受けるため、顔・画像を認識することが難しくなります。日常のさまざまなシーンでセンシングができるようになるには、まだまだ技術的な課題が多くあります。この課題をクリアするために、開発メンバーの努力が今も続けられています。

*4:「誰が、今どのような状態にあるか」といった情報を聴覚(音声)・触覚(振動)を通じて伝達し、ユーザーの誘導を行なうにあたっては、コンソーシアムメンバであるアルプスアルパイン社の触覚インターフェースに関する知見が活かされています。

新型コロナウイルスは、この「空気を読む技術」の開発に新たな課題を生み出しました。それは、マスクの着用とソーシャルディスタンスの確保が、顔や表情の認識を難しくするという問題です。しかし、すでにそれらの課題を克服するために、新たな技術開発が始まっています。

チームリーダーの山本は技術開発への姿勢をこのように語っています。

「人々のお困りごとを解決するために、研究者として一歩先を見据えた新たな技術を生み出していく。そして、出来上がった技術をカタチにして、社会に届けていきたい」

「目が見えない」「手が自由に使えない」といった障がい者が抱える課題・ニーズから、電話やキーボードといった新しいコミュニケーションツールが生まれました。AIスーツケースの開発で培われた技術も、視覚障がい者だけではなく、一人で移動するには誰かのサポートが必要な人の助けになり、また、コミュニケーションを支援したり、人と協働して働くロボットの開発などにも役立つことでしょう。障がいのある人もない人も、互いに、その人らしさを認め合いながら共に生きる、そんな社会の実現のために、「AIスーツケース」プロジェクトは実証実験を経て、社会実装に向け進んでいます。