2023/08/08

人混み環境の中で移動する人の動きを手掛かりに自己位置推定*1

*1: Mai Nishimura, Shohei Nobuhara, and Ko Nishino, “View Birdification in the Crowd: Ground-Plane Localization from Perceived Movements,’’ International Journal of Computer Vision (IJCV), Vol. 131, Issue 8, pp. 2015-2031, 2023. (京都大学 西野恒研究室との共同研究成果)

OSXの研究グループについて紹介するシリーズ記事 第2弾では、PERCEPTIONグループのSpatial Perception(空間認知)技術について概要を紹介します。

我々は、人が介在する不確実性の高い実社会において、人と協調・共存して活躍するモバイルロボットの実現を目指しています。一般的なモバイルロボットは、倉庫や工場、公共施設などの環境において、運搬や警備、清掃、案内など多様なシーンで利用されています。これらのモバイルロボットは、搭載された画像センサや深度センサを使用してSLAM(Simultaneous Localization and Mapping)による環境地図構築および自己位置推定を行い、自律移動システムを実現しています。一方で、歩行者や自転車、自動車、ロボットなどの移動体が存在するような動的な環境では、通常のSLAMシステムはそれらを外れ値や障害物として除外する必要があり、動作が不安定になりがちです。とくにセンサ視界のほとんどが移動体で覆われてしまうような混雑シーンでは、自己位置推定が失敗し、モバイルロボットの自律走行が困難になります。

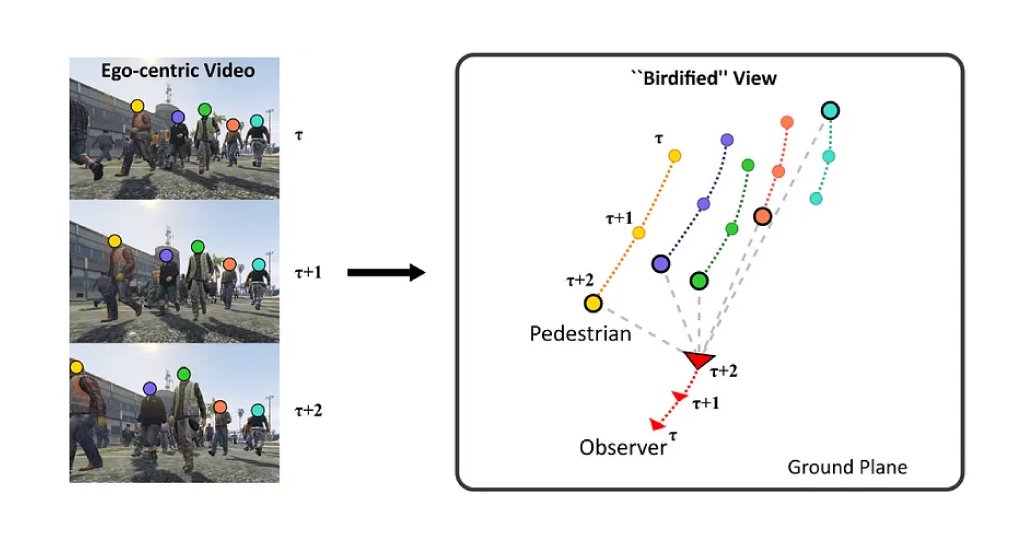

我々は、モバイルロボット単体での自律移動を超えて、人と、またはロボット同士とも協調移動できるモバイルロボットのための空間認知技術を開発しています。スクランブル交差点や駅構内、空港、大規模なイベント会場など、多数の人が行き来するような環境においては、ロボット周囲の状況が刻一刻と大きく変化します。そのような混雑環境において、モバイルロボットが正確かつロバストに周囲環境や自己位置を認識できるようになるためには、従来の枠組みを超えた空間認知技術が必要となります。我々は、動的な移動体を外れ値としてではなく自己位置推定のための手がかりとして用いる新たな空間認知技術*1や、一人称視点から俯瞰視点における自己・歩行者位置の推定、深層学習を用いた3次元ビジョン技術、人物追跡を要しない群衆密度変化の予測*2などに取り組んでいます。

人物追跡を要しない群衆密度変化の予測*2

*2: Hiroaki Minoura, Ryo Yonetani, Mai Nishimura, and Yoshitaka Ushiku, “Crowd Density Forecasting by Modeling Patch-based Dynamics,’’ IEEE Robotics and Automation Letters (RA-L), Vol. 6, Issue 2, pp. 287-294, 2021.

我々は、人混みでの配送サービスや、街中でゴミの自動収集、セキュリティパトロールなど、人とロボット、またはロボット同士が協調しながら安全に移動し、モバイルロボットが当然の存在となっている近未来を創っていきます。

資料をダウンロード

資料をダウンロード